注意: 此小节可能会需要你的电脑有较高的配置

我们之前所使用的是在线的大模型,通常情况下这需要我们给这些模型提供商支付费用,并且需要稳定的网络连接。而本地部署大模型则可以解决这些问题,让我们能够在没有网络的环境下使用大模型,同时也能更好地保护数据隐私。今天我们将介绍如何使用 LM Studio 来本地部署大模型。

简介 LM Studio

LM Studio 是一款专为本地大模型运行设计的桌面应用,由 Element Labs Inc. 开发,支持 Windows 和 macOS 系统。它的核心优势在于:

- 提供图形化操作界面,无需复杂的命令行知识

- 内置模型库,可直接下载主流开源大模型

- 支持多种模型格式(GGUF 为主,这是一种高效的模型压缩格式)

- 内置聊天界面,可直接与模型交互

- 支持将本地模型作为 API 服务运行,供其他应用调用

- 自动管理模型依赖和硬件加速

我们可以前往他的官网进行下载: LM Studio 官网

系统配置要求

本地运行大模型对硬件有一定要求,具体取决于模型大小:

- CPU运行:至少8GB内存(推荐16GB以上),适合7B参数以下的小型模型

- GPU运行:

- NVIDIA显卡:支持CUDA,至少4GB显存(推荐8GB以上,如RTX 3060/4060及以上)

- AMD显卡:支持Metal(macOS)或ROCm(Linux)

- Apple Silicon:M1/M2/M3芯片,至少8GB统一内存(推荐16GB以上)

注意:参数越大的模型(如13B、33B、70B)需要更多的内存/显存,建议根据自己的硬件配置选择合适的模型。 LM Studio 会自动给你匹配一个合适的模型大小

安装 LM Studio 详细步骤

- 访问LM Studio官方网站: https://lmstudio.ai/

- 点击首页的"Download"按钮,根据你的操作系统选择对应版本:

- Windows:下载.exe安装文件

- macOS:下载.dmg镜像文件

- 安装过程:

- Windows:双击安装文件,同意许可协议,选择安装路径(建议默认路径),点击"Install"完成安装

- macOS:打开.dmg文件,将LM Studio拖入Applications文件

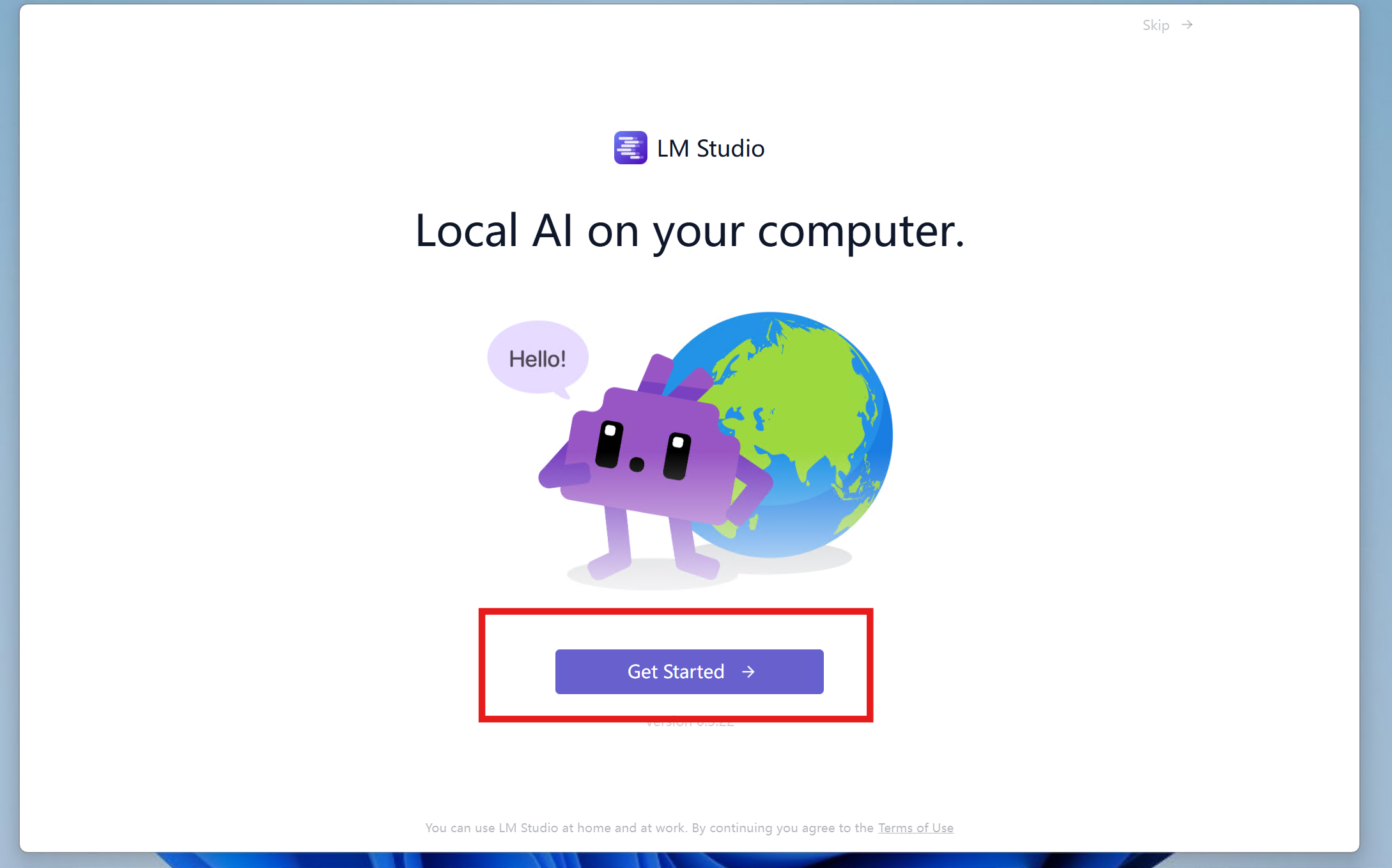

安装完成后,在桌面或应用程序文件夹中找到LM Studio图标,双击启动应用。

打开后点击 Get Started

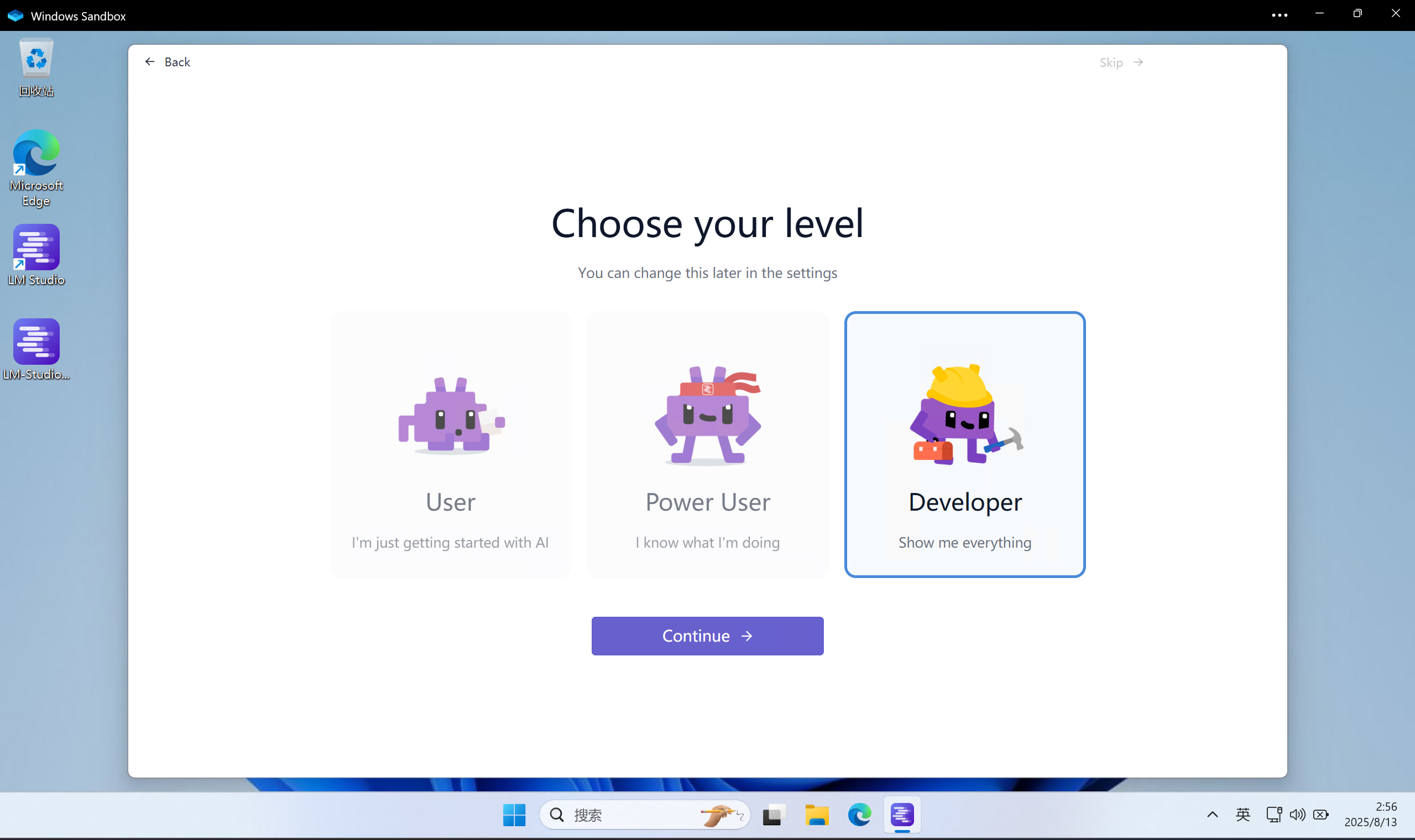

选择用户等级我们可以选择第三个

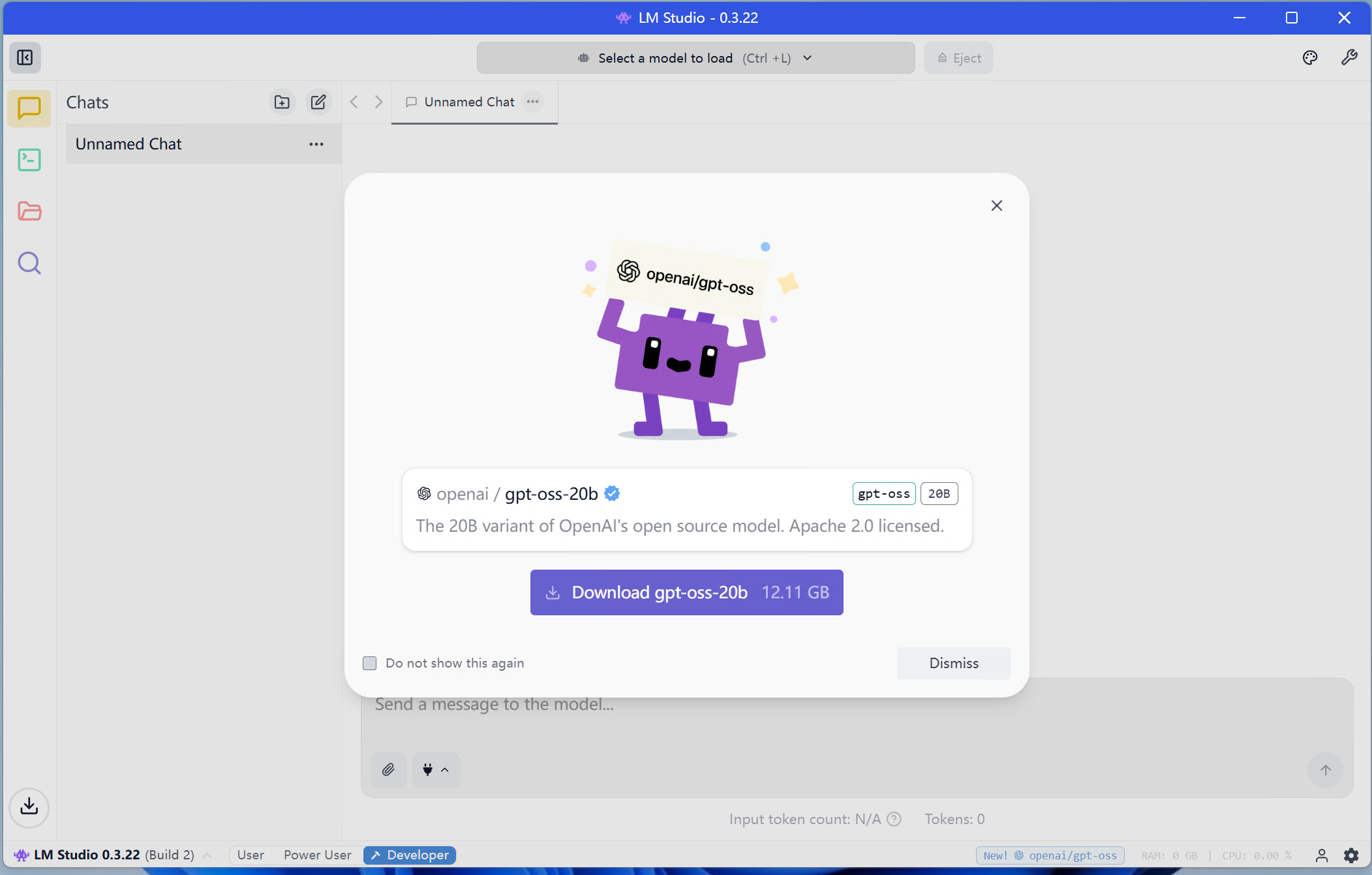

如果有弹出这个弹窗, 我们给他关掉就好

现在看着全是英文, 我们可以将他调整为中文, 点击最右下角的齿轮, 在 Language 那里选择中文

在最开始, 他会自动帮我们下载一个运行环境, 在左下角的下载里面可以看到, 不同的设备他会自动匹配最适合的运行环境

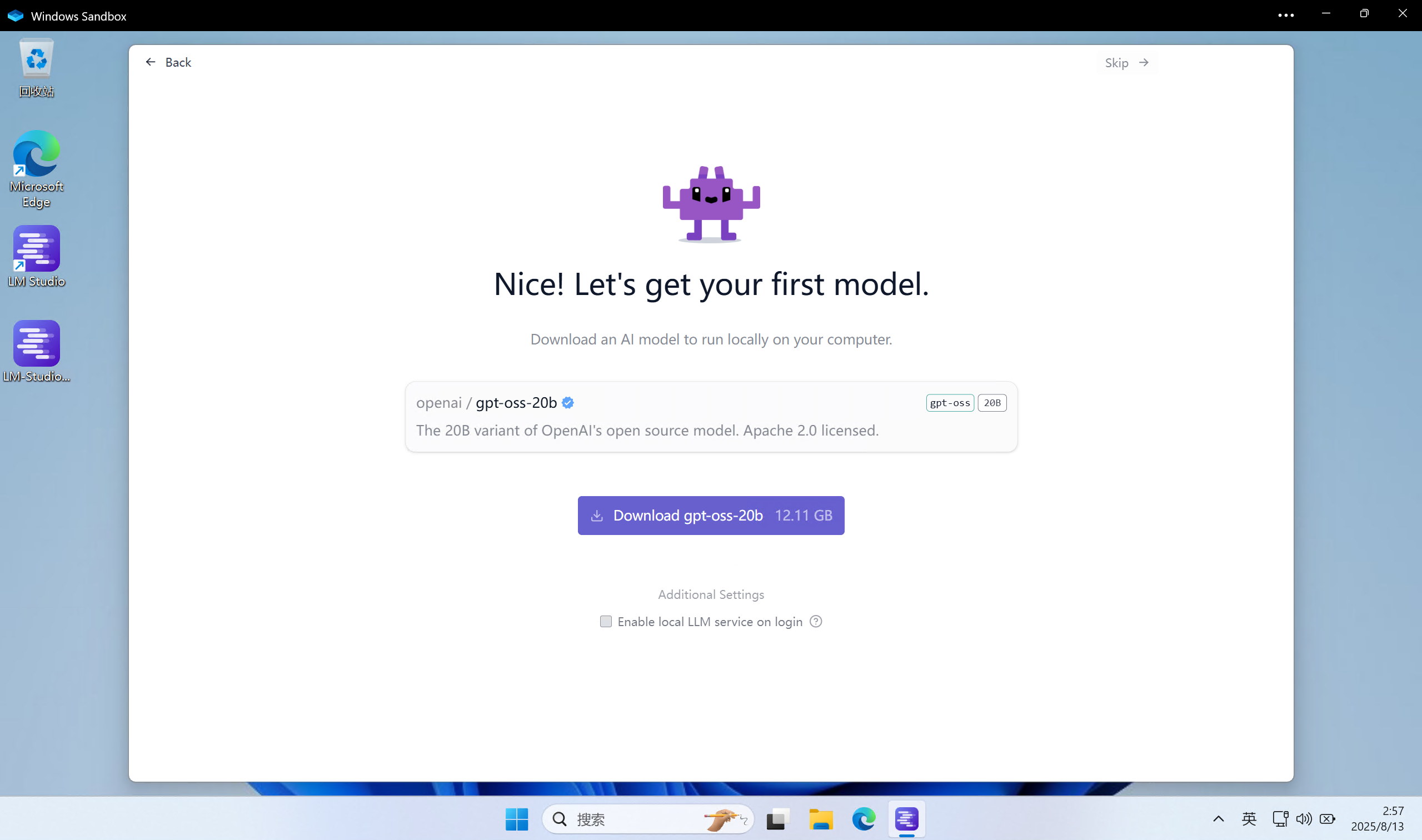

浏览和下载模型

LM Studio的Model Hub汇集了来自Hugging Face等平台的主流开源模型,下载步骤如下:

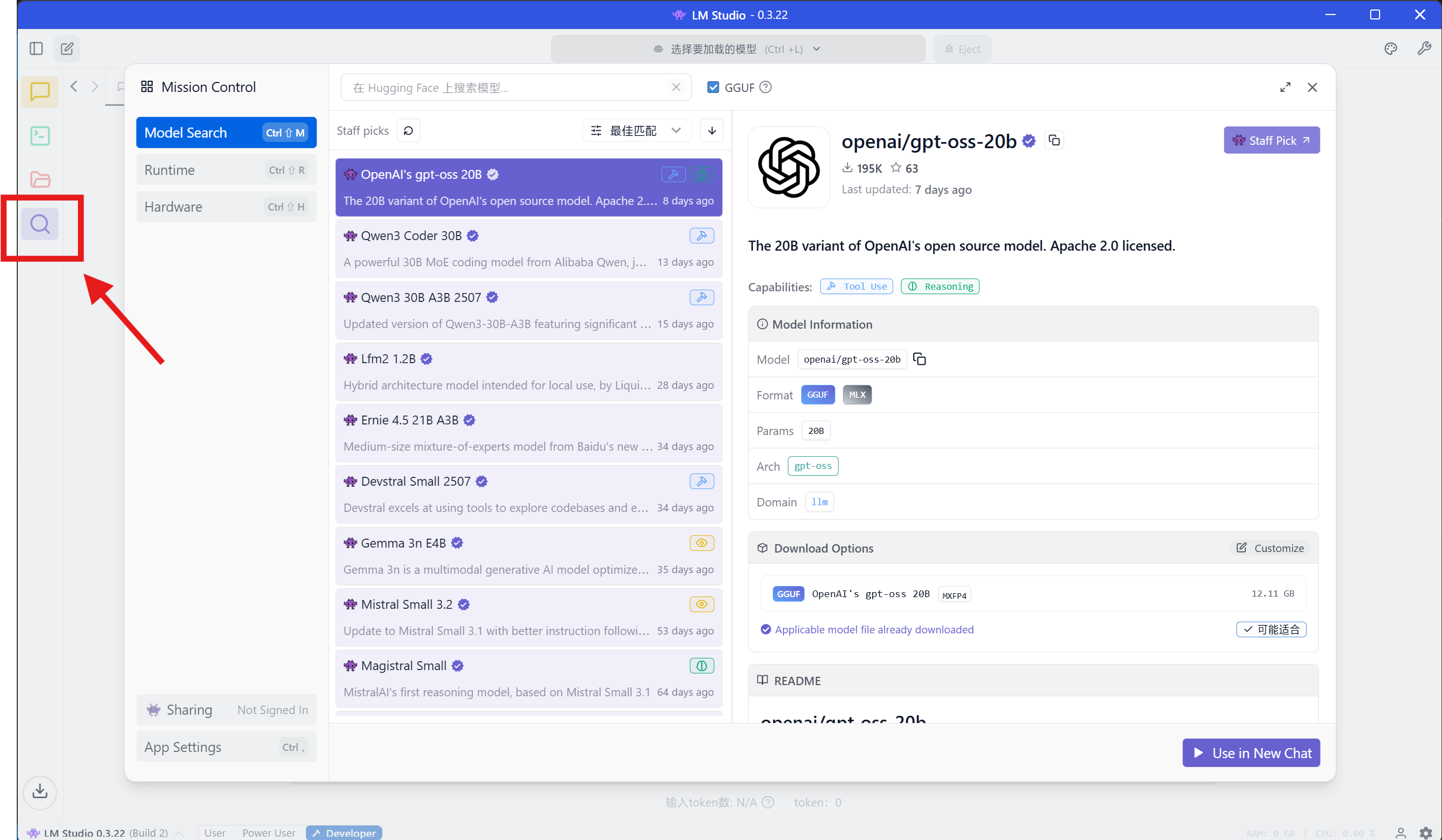

- 启动LM Studio后,在左侧导航栏点击"Model Hub"

可以看到这里有很多的模型供我们下载

下面对他们进行一个简单的介绍:

openai/gpt-oss-20b是 OpenAI 前几天开源的 ChatGPT 模型, 速度快, 生成的质量也不错qwen3-coder-30b是阿里千问团队训练的模型, 专门对代码进行了优化google/gemma-3n-e4b是 Google 训练的较为通用的模型deepseek/deepseek-r1-0528-qwen3-8b是 Deepseek 二次训练了 Qwen 模型使其能够进行 CoT (链式思考), 同时也对模型大小进行了蒸馏

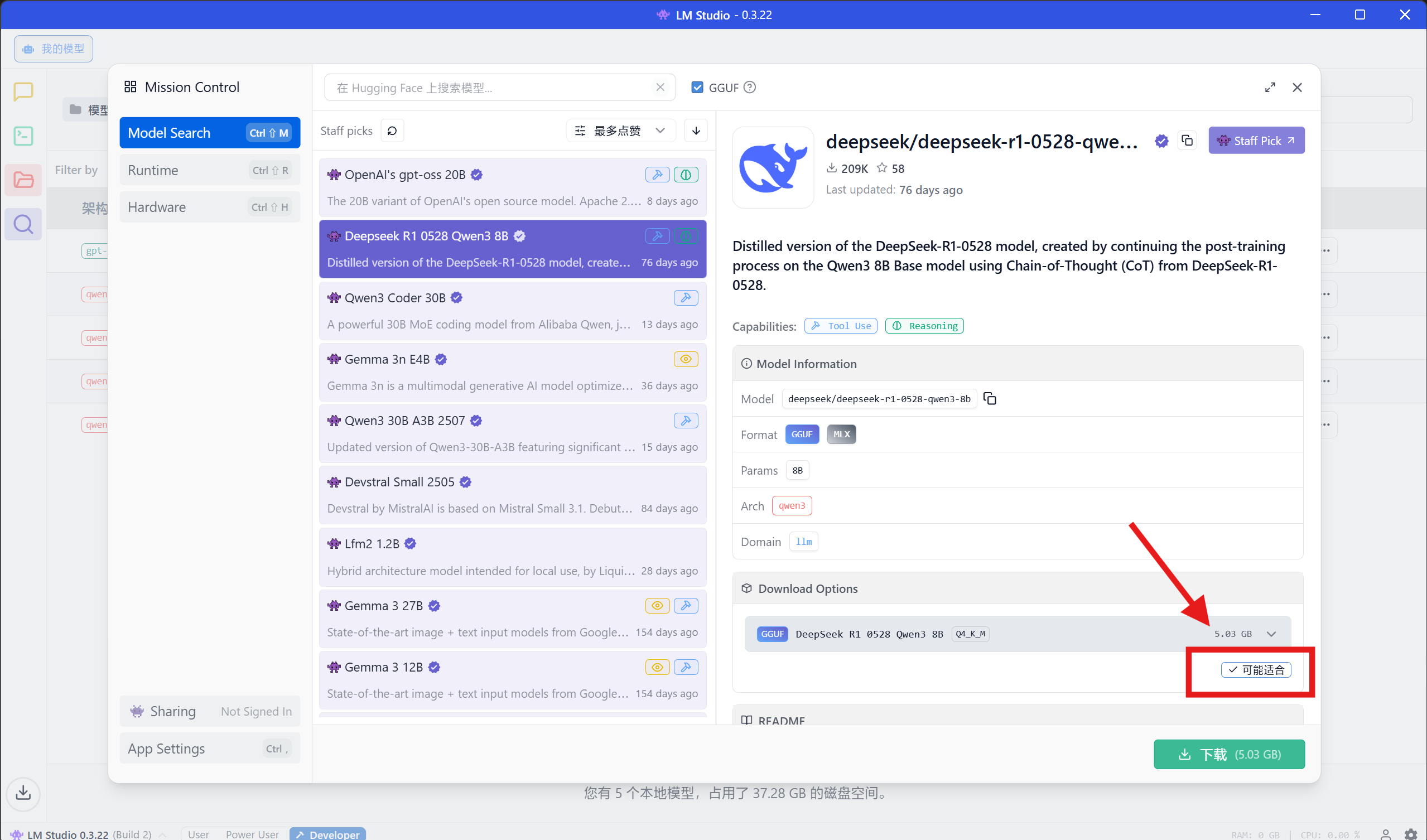

在我们选择了具体的模型之后, 他会自动选择一个适合我们的模型, 我们这个时候就可以点击下载

当然由于模型都比较大, 你可以在开始前先修改下模型加载到的位置

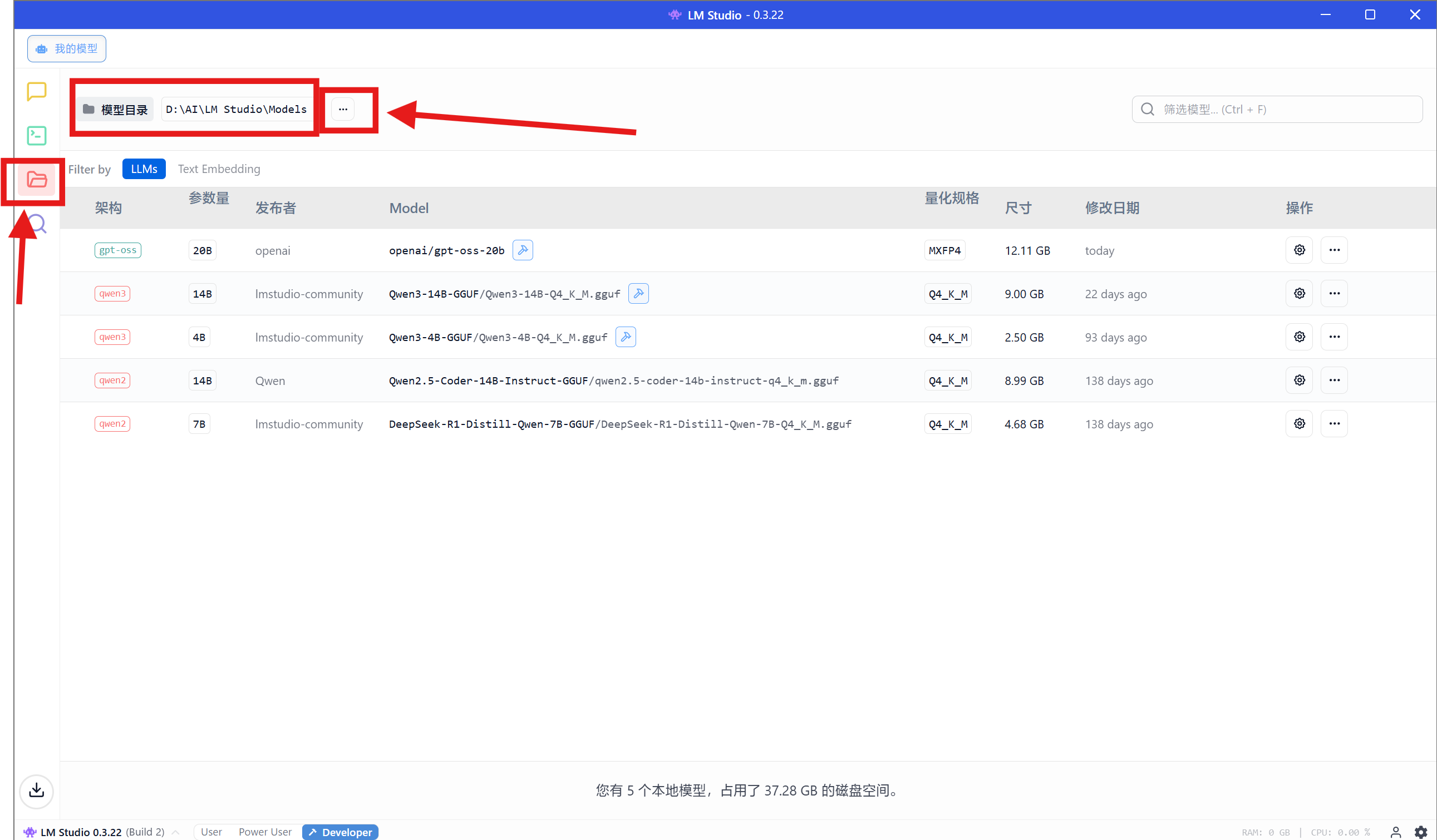

我们可以先前往我的模型那里去修改一下模型目录

加载并使用模型

模型下载完成后,就可以开始使用了:

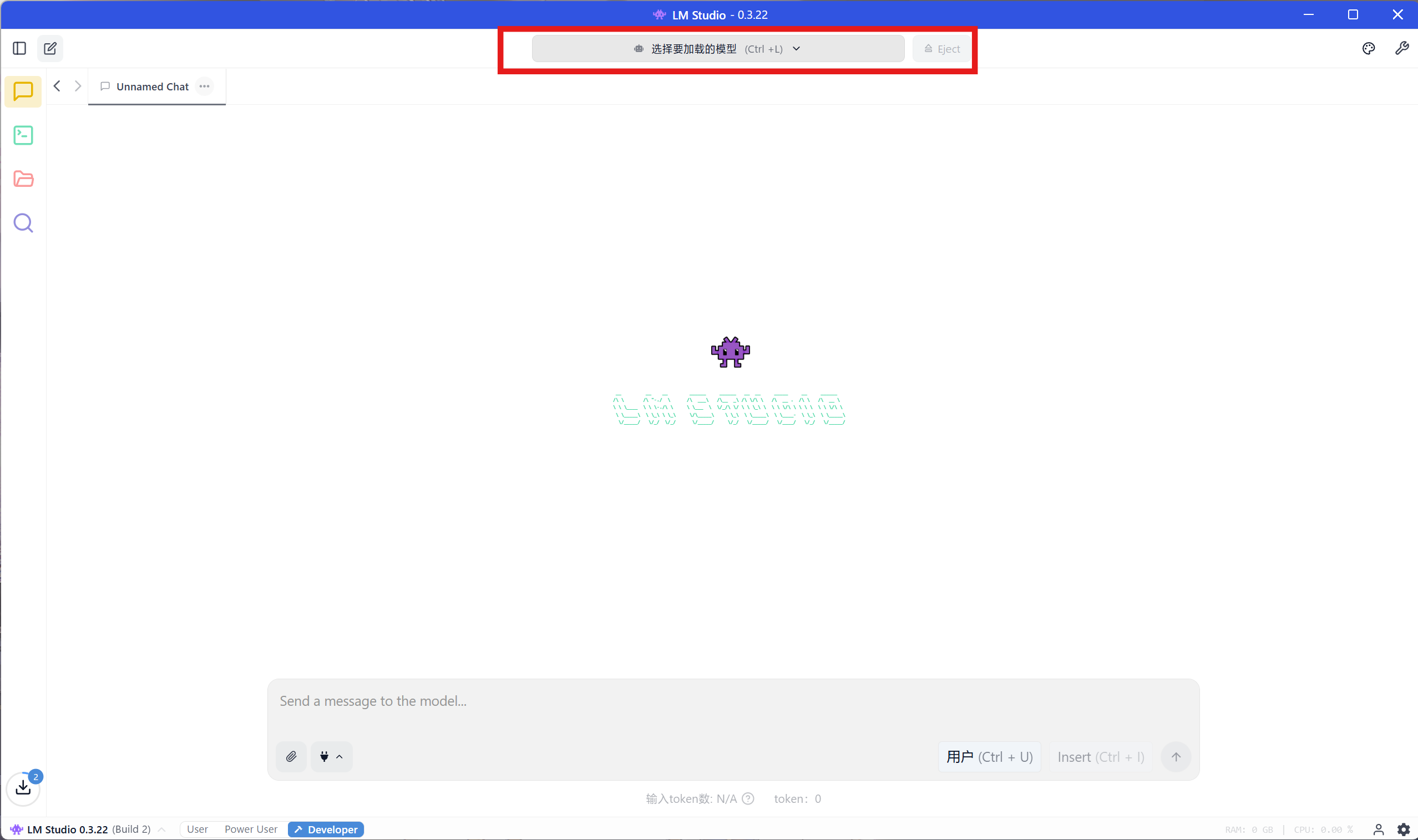

切换到第一个 Chat 对话标签页

- 选择要运行的模型,点击顶部的"Load"按钮

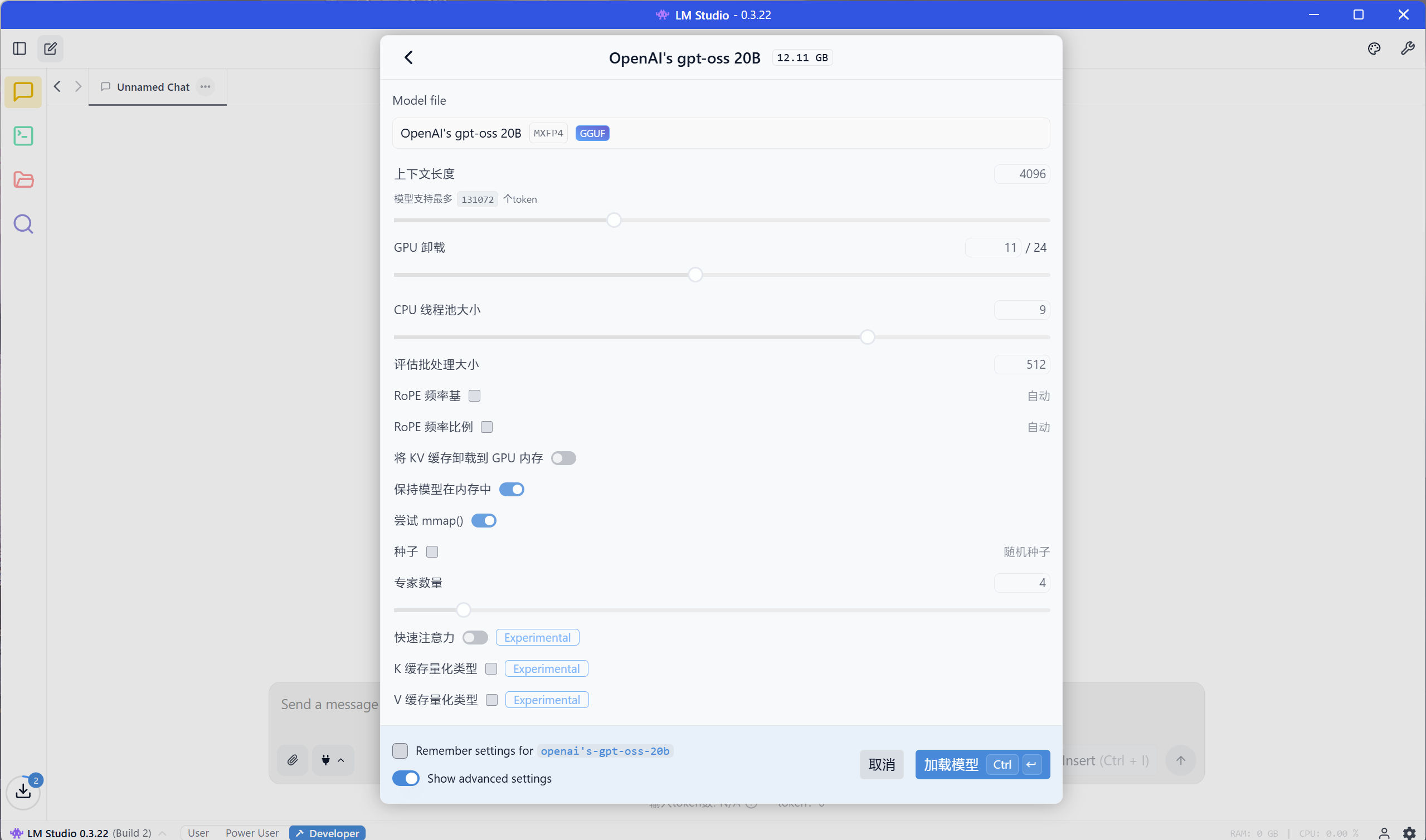

选择后我们可以修改配置:

下面对一些我们可以操作的参数介绍一下:

- 将 KV 缓存加载到 GPU 内存 (Pre-load KV cache to GPU memory)

KV 缓存(Key-Value cache)是模型在生成文本时存储中间结果的地方。勾选这个选项可以把这部分缓存放到显卡上,从而加快生成速度,但会占用显存。

- 保持模型在内存中 (Keep model in memory)

勾选这个选项后,即使你关闭了聊天窗口,模型也会一直保持加载状态,这样你下次再使用时就不用等待加载了,但它会一直占用你的显存或内存。

- 尝试 mmap() (Attempt mmap())

这是一个技术选项,用于控制模型文件的读取方式。勾选后,系统会尝试将模型文件直接映射到内存中,可以提高加载速度。

- 种子 (Seed)

随机种子 (Random seed): 类似于一个随机数的起点。如果你用同一个种子,模型在同样的问题下,每次都会给出完全相同的回答。如果你想得到不同的回答,可以不设置种子,或者使用随机种子。

- 专家数量 (Number of experts)

这个选项是针对 MoE (Mixture of Experts) 模型的。简单来说,MoE 模型不是一个巨大的模型,而是由多个小专家模型组成的。这个选项可以设置每次生成时调用多少个专家来共同完成任务。

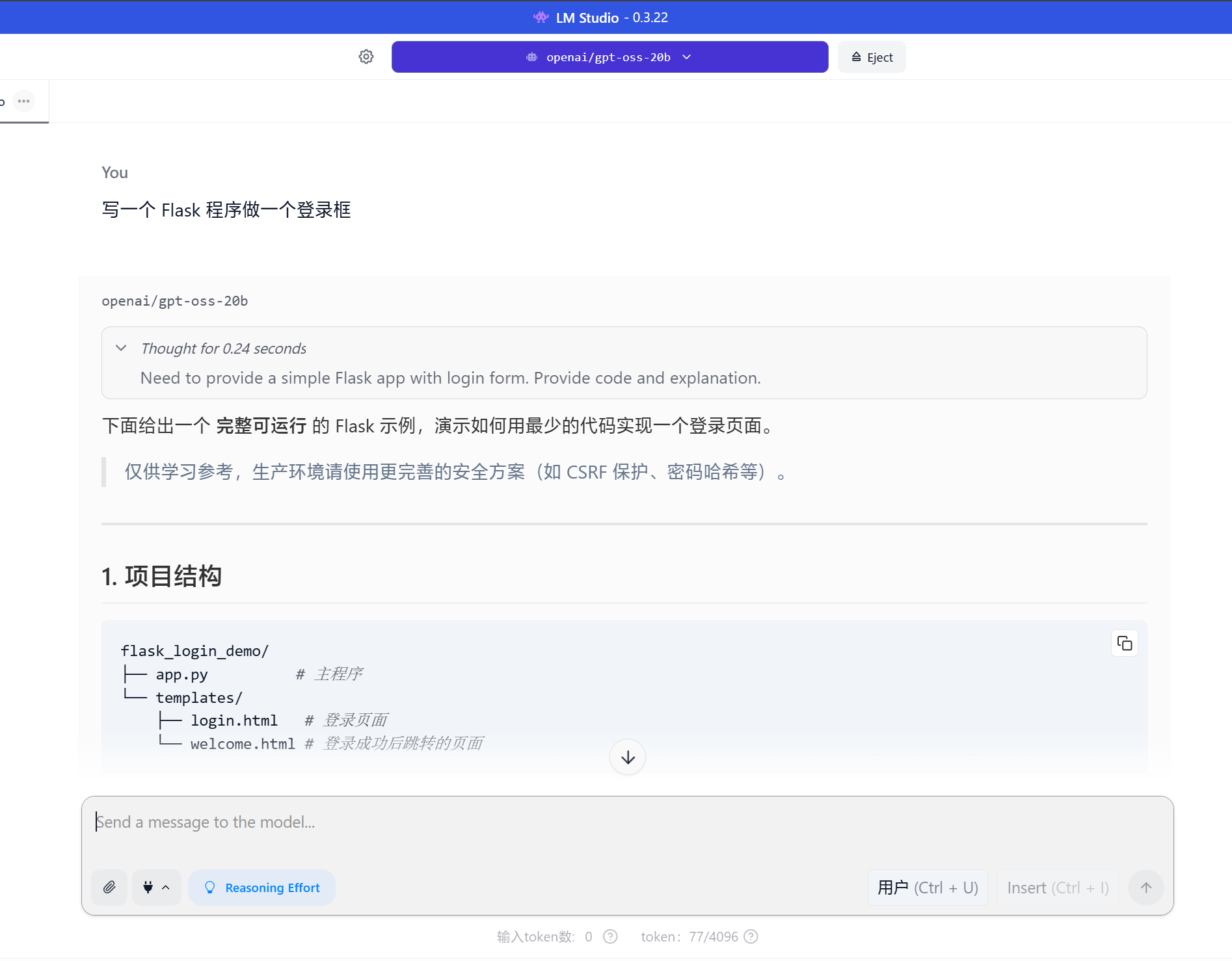

之后我们就可以加载模型开始使用了

如果不需要使用了, 我们点击最上方的 Eject 即可卸载模型

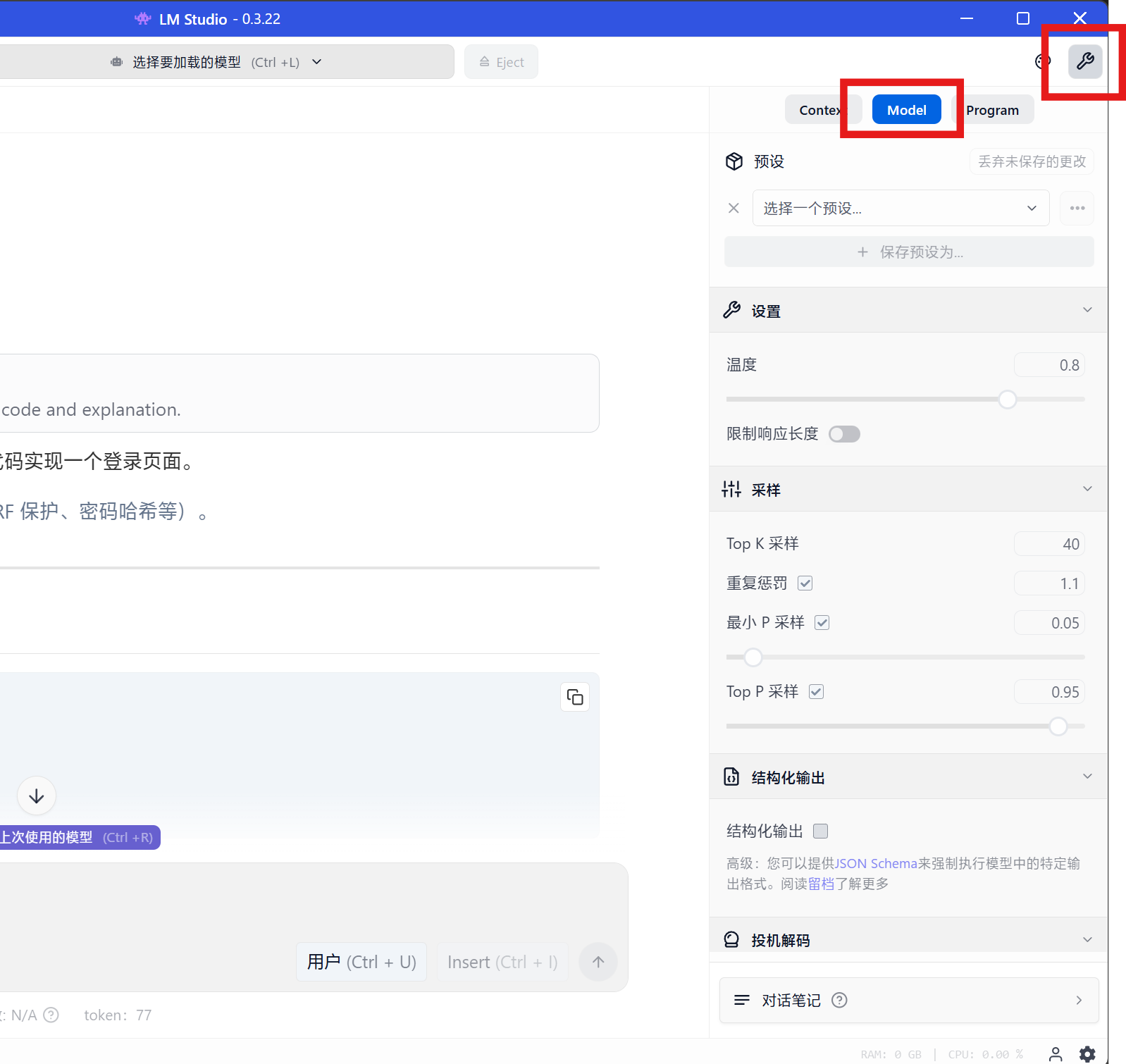

在右上角力我们还可以改变模型的一些配置

这些参数在第一天我们已经介绍过了

高级功能:将模型作为API服务运行

LM Studio还支持将本地模型模拟为OpenAI兼容的API服务,供其他应用调用:

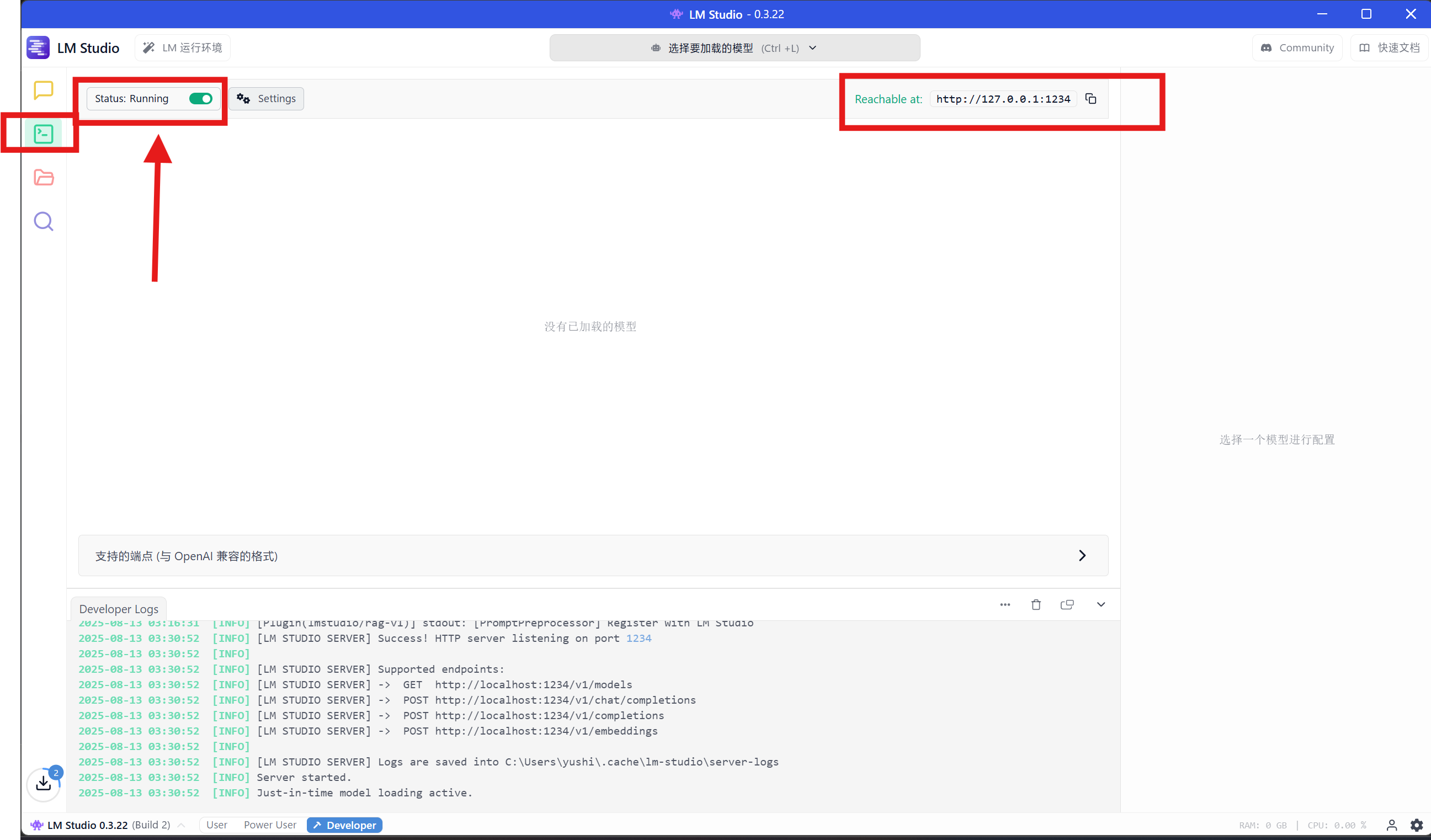

我们切换到开发者选项卡

开启这个开关后我们能看到右边显示了一个网址

之后我们就可以使用其他的程序来调用我们的 LM Studio 了, 比如我们之前的 Python 代码可以将 api_base 改成这个网址

例如,使用Python调用的示例代码:

client = OpenAI(

base_url="http://127.0.0.1:1234/v1",

api_key="68c6d0af-7fb9-4e84-9134-d93f643aa343", # 这里随便填

)注意加上这个 /v1

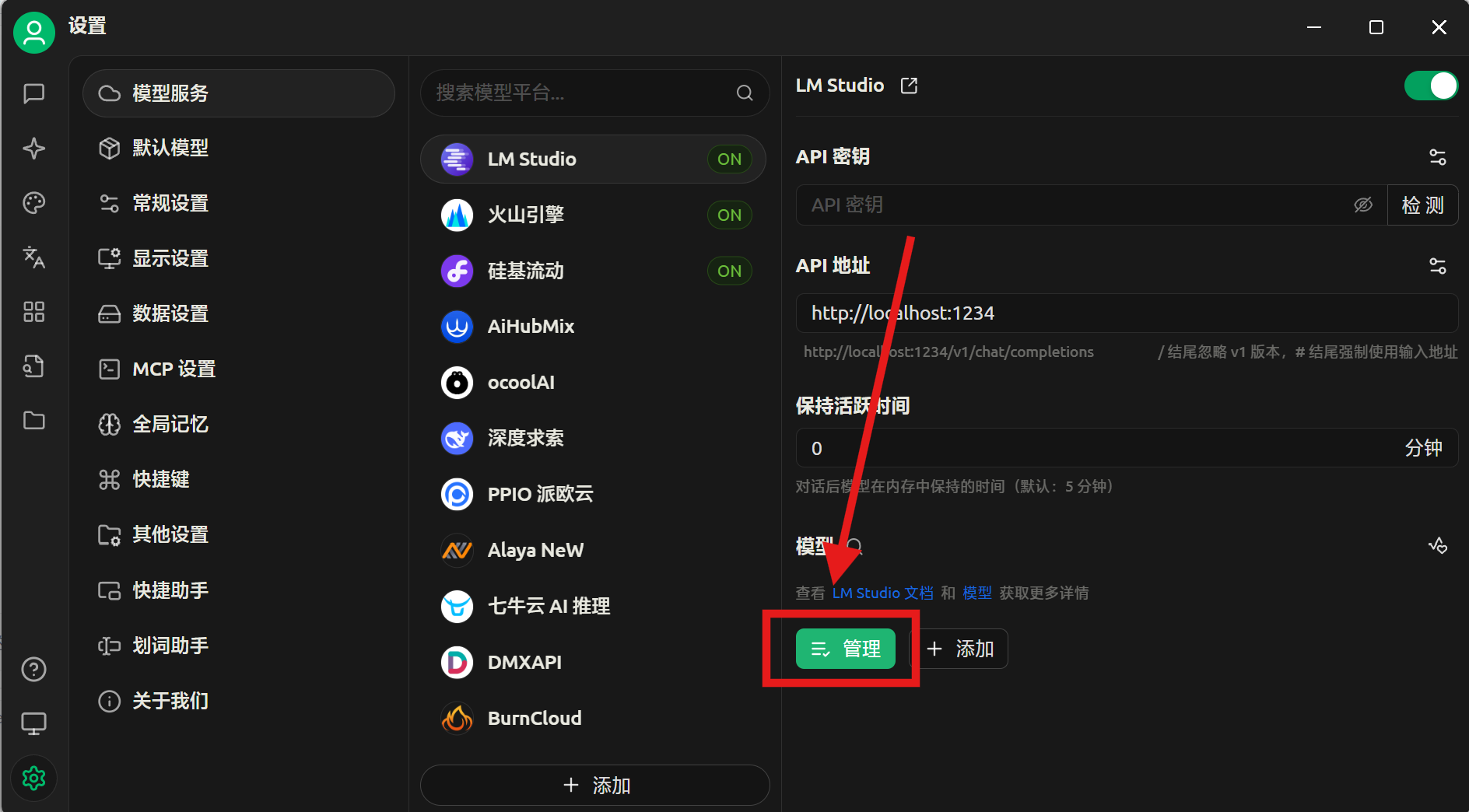

或者我们也可以调用 Cherry Studio 进行对接

找到LM Studio 后, API 地址填写这个网址即可

之后我们点击管理, 这里可以看到我们之前下载的模型, 点击右侧的 + 添加, 之后再启用 LM Studio

可以看到这边也能正常使用, 我们便可以完全使用离线的大模型来做到之前的很多操作了

模型管理与优化

- 模型删除:在"我的模型"页面,点击模型右侧的"…"按钮,选择"Delete"可删除不需要的模型,释放存储空间

- 性能优化:

- 如运行卡顿,可尝试降低模型参数或选择量化程度更高的版本(如q40比q50更省资源)

- 关闭其他占用大量资源的应用

- 增加虚拟内存(Windows)或调整内存分配(macOS)

- 更新模型:在Model Hub中,已下载的模型有更新时会显示"Update"按钮,可更新到最新版本

原创:Kengwang 编辑:GoForth

练习

完成文中的操作,自己尝试模型,可以将以前的学习内容在这上面自己实践一下。